Marca D’água Generativa: A Arma Secreta Contra Deepfakes na Era da IA

Imagine receber uma videochamada de um ente querido, com sua voz e rosto perfeitos, pedindo ajuda financeira urgente. Você, preocupado, faz a transferência. Horas depois, descobre que foi vítima de um golpe: a pessoa na chamada era um deepfake, uma criação ultrarrealista de inteligência artificial. Essa situação, que parece saída de um filme de ficção científica, já é uma realidade no Brasil e no mundo, expondo uma das facetas mais perigosas da era digital. À medida que a IA generativa avança, a linha entre o real e o sintético se torna cada vez mais tênue, criando um campo fértil para desinformação, fraudes e manipulação em massa. Mas, em meio a esse desafio, uma tecnologia inovadora surge como uma poderosa aliada na proteção da verdade: a marca d’água generativa.

Este artigo mergulha fundo nessa tecnologia emergente, listada pelo Fórum Econômico Mundial como uma das Top 10 Tecnologias Emergentes de 2025 [1]. Vamos explorar como ela funciona, quem está liderando seu desenvolvimento e por que ela é crucial para a segurança digital dos brasileiros, especialmente com as eleições de 2026 no horizonte. Prepare-se para descobrir a arma secreta que está sendo forjada para combater os deepfakes e restaurar a confiança no conteúdo que consumimos online.

O que são Deepfakes e Por Que Representam uma Ameaça Crescente?

O termo “deepfake” resulta da combinação de “deep learning” (aprendizagem profunda) e “fake” (falso). Trata-se de uma técnica de inteligência artificial que permite criar ou alterar conteúdos de vídeo ou áudio para que pareçam autênticos e reais, quando na verdade não são. Utilizando redes generativas adversariais (GANs), os algoritmos são treinados com vastas quantidades de dados (fotos e vídeos de uma pessoa) para aprender a imitar suas características faciais, expressões, voz e maneirismos com uma precisão assustadora.

Inicialmente, os deepfakes ganharam notoriedade em contextos de entretenimento e paródia, mas rapidamente seu potencial para uso malicioso se tornou evidente. Hoje, as ameaças se estendem por diversas áreas:

- Fraudes Financeiras: Golpistas utilizam deepfakes de voz e vídeo para se passar por executivos de empresas, autorizando transferências fraudulentas, ou por familiares em situações de emergência, enganando pessoas para que enviem dinheiro.

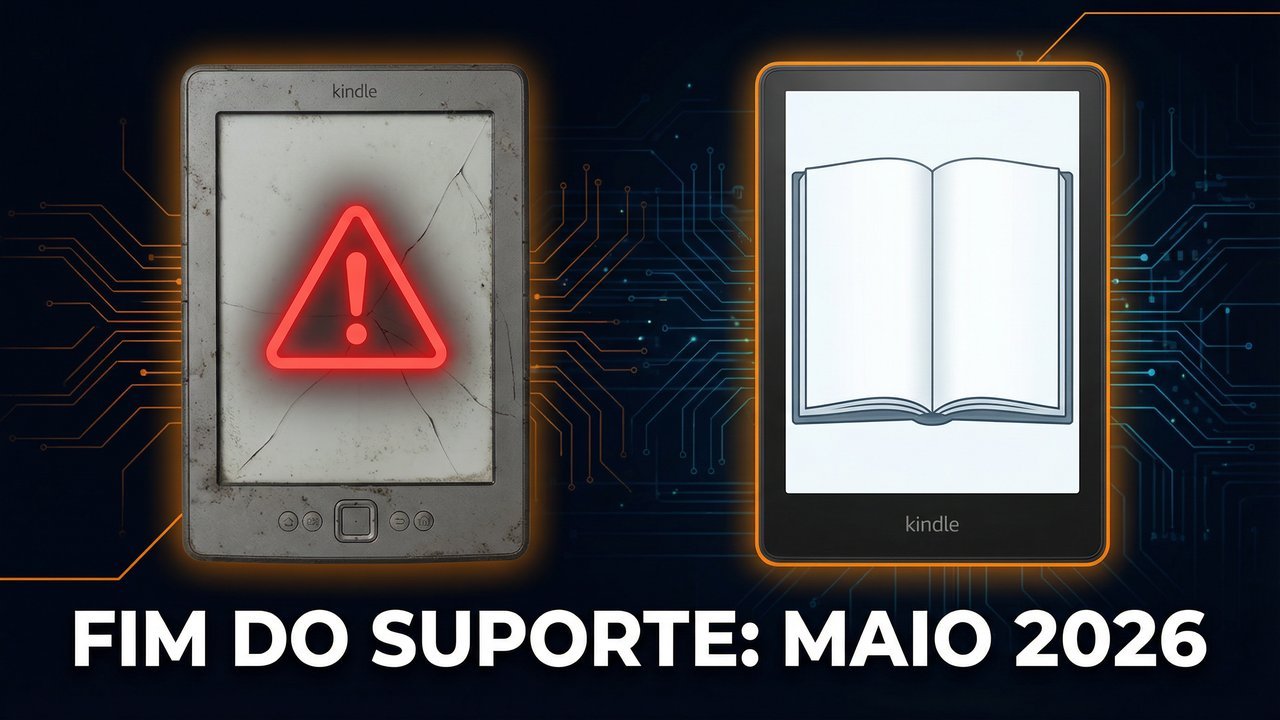

- Desinformação e Manipulação Política: A criação de vídeos falsos de políticos fazendo declarações controversas ou escandalosas pode manipular a opinião pública, influenciar eleições e desestabilizar processos democráticos. O Senado Federal brasileiro já demonstra preocupação com o impacto dos deepfakes nas eleições de 2026 [2].

- Danos à Reputação e Assédio: Deepfakes são usados para criar conteúdo pornográfico não consensual, inserindo o rosto de pessoas em vídeos explícitos, uma forma de violência e assédio digital com consequências devastadoras para as vítimas.

- Crimes de Extorsão: Ameaças de divulgação de vídeos íntimos falsos são usadas para extorquir dinheiro ou favores das vítimas, que temem o impacto em suas vidas pessoais e profissionais.

A rápida evolução e a crescente acessibilidade das ferramentas de IA generativa, como o Sora da OpenAI, Midjourney e outras, significam que a criação de deepfakes convincentes não está mais restrita a especialistas com alto poder computacional. Esse cenário de democratização da tecnologia, embora impulsione a criatividade, também amplifica os riscos, tornando a necessidade de soluções de detecção e autenticação mais urgente do que nunca.

A Solução: O que é a Marca D’água Generativa?

Em resposta direta à ameaça dos deepfakes, pesquisadores e gigantes da tecnologia estão desenvolvendo e implementando a marca d’água generativa (ou “generative watermarking”). Diferente das marcas d’água visíveis que estamos acostumados a ver em fotos e vídeos (como o logotipo de um canal de TV), a marca d’água generativa é, na maioria das vezes, invisível ao olho humano.

Trata-se de um sinal ou padrão sutil e imperceptível que é incorporado diretamente nos dados de um conteúdo (imagem, vídeo ou áudio) durante seu processo de criação pela inteligência artificial. Esse sinal funciona como uma espécie de “impressão digital” ou “DNA digital”, atestando que aquele conteúdo foi gerado ou modificado por um sistema de IA.

A grande vantagem dessa abordagem é que a marca d’água é projetada para ser robusta e persistir mesmo que o conteúdo seja comprimido, cortado, redimensionado ou alterado. Enquanto uma marca d’água visível pode ser facilmente removida com ferramentas de edição, a marca d’água generativa é muito mais difícil de ser eliminada sem degradar significativamente a qualidade do arquivo, tornando-a um mecanismo de defesa muito mais eficaz.

Como Funciona a Magia por Trás da Marca D’água?

A implementação da marca d’água generativa pode variar, mas o princípio fundamental envolve a manipulação de padrões sutis nos dados do conteúdo. Por exemplo, em uma imagem, a IA pode ser instruída a alterar levemente a cor ou o brilho de pixels específicos, seguindo um padrão pré-definido. Essas alterações são tão mínimas que são indetectáveis para uma pessoa, mas podem ser facilmente identificadas por um algoritmo projetado para procurar por esse padrão específico.

O processo pode ser dividido em duas etapas principais:

- Incorporação (Embedding): Durante a geração do conteúdo, o modelo de IA insere a marca d’água. Isso pode ser feito alterando sutilmente os pixels em uma imagem, as frequências em um arquivo de áudio ou os quadros em um vídeo. O padrão inserido é único e associado ao sistema de IA que o gerou.

- Detecção (Detection): Para verificar a autenticidade de um conteúdo, um algoritmo detector analisa o arquivo em busca do padrão da marca d’água. Se o padrão for encontrado, o sistema pode confirmar com um alto grau de certeza que o conteúdo foi gerado por IA e, em alguns casos, até mesmo identificar qual modelo específico o criou.

Empresas como a OpenAI já anunciaram a inclusão de marcas d’água em seus modelos de geração de vídeo, como o Sora, para ajudar a identificar o conteúdo gerado por eles [3]. Essa é uma medida proativa crucial para mitigar os riscos associados à disseminação de deepfakes.

Quem Está na Vanguarda da Luta Contra os Deepfakes?

A corrida para desenvolver e padronizar a tecnologia de marca d’água generativa é liderada por um consórcio de gigantes da tecnologia, instituições acadêmicas e organizações internacionais. Alguns dos principais atores incluem:

- OpenAI: A criadora do ChatGPT e do Sora está na linha de frente, implementando marcas d’água em seus modelos para garantir a rastreabilidade do conteúdo gerado.

- Google: O Google está pesquisando e desenvolvendo ativamente suas próprias técnicas de marca d’água, como o SynthID, que se mostrou promissor na identificação de imagens geradas por IA.

- Meta: A empresa por trás do Facebook e Instagram anunciou planos para rotular imagens geradas por IA em suas plataformas, utilizando tecnologias de detecção de marca d’água.

- Microsoft: Como uma das principais parceiras da OpenAI, a Microsoft apoia e contribui para os esforços de desenvolvimento de tecnologias de autenticidade de conteúdo.

- Adobe: Através da sua “Iniciativa de Autenticidade de Conteúdo” (Content Authenticity Initiative), a Adobe está trabalhando para criar um padrão aberto e gratuito para a proveniência de conteúdo digital.

Além das empresas, organizações como a União Internacional de Telecomunicações (UIT) estão trabalhando na criação de padrões técnicos para a marca d’água e autenticidade de multimídia, buscando um consenso global sobre como combater a desinformação gerada por IA [4].

Aplicações no Brasil: Protegendo as Eleições e o Bolso do Cidadão

No contexto brasileiro, a aplicação da marca d’água generativa é de extrema importância. Com a polarização política e a proximidade das eleições de 2026, o potencial de uso de deepfakes para criar escândalos falsos e manipular o eleitorado é uma ameaça real e iminente. A capacidade de verificar rapidamente se um vídeo de um candidato é autêntico ou uma criação de IA será uma ferramenta vital para jornalistas, checadores de fatos e para o próprio Tribunal Superior Eleitoral (TSE) no combate às fake news.

Além da esfera política, a tecnologia oferece uma camada de proteção crucial contra golpes financeiros. Instituições bancárias e empresas de segurança digital poderiam integrar detectores de marca d’água em seus sistemas para identificar e bloquear tentativas de fraude que utilizam deepfakes de voz ou vídeo, protegendo o patrimônio dos cidadãos.

Desafios e Limitações no Horizonte

Apesar de seu enorme potencial, a marca d’água generativa não é uma bala de prata. A tecnologia enfrenta desafios significativos que precisam ser superados:

- Adoção Desigual: Para que a tecnologia seja eficaz, ela precisa ser adotada de forma ampla e padronizada por todos os desenvolvedores de modelos de IA. Modelos de código aberto ou sistemas desenvolvidos por atores mal-intencionados podem optar por não incluir marcas d’água.

- Remoção Maliciosa: Assim como há uma corrida para desenvolver as marcas d’água, há também uma corrida para “quebrá-las”. Já existem pesquisas e serviços que tentam remover esses sinais invisíveis dos arquivos.

- Falsos Positivos e Negativos: Nenhum sistema é perfeito. Existe o risco de um detector rotular incorretamente um conteúdo real como falso (falso positivo) ou não conseguir identificar um deepfake (falso negativo).

Como se Proteger: Dicas Práticas para Identificar Deepfakes

Enquanto a tecnologia de marca d’água amadurece, a literacia digital continua sendo nossa melhor defesa. Aqui estão algumas dicas para ajudá-lo a identificar um possível deepfake:

- Observe os Detalhes do Rosto: Preste atenção a piscadas de olhos que parecem pouco naturais (muito rápidas, lentas ou ausentes), sincronia labial imperfeita e expressões faciais que não correspondem ao tom de voz.

- Procure por Inconsistências na Imagem: Fique atento a iluminação estranha, sombras que não correspondem à cena, reflexos incorretos nos olhos ou óculos e bordas borradas ou distorcidas ao redor da cabeça e do cabelo.

- Analise a Qualidade do Áudio: Uma voz robótica, entonação estranha, ruído de fundo inconsistente ou palavras mal pronunciadas podem ser sinais de um áudio gerado por IA.

- Desconfie de Situações Urgentes e Inesperadas: Se receber uma chamada ou mensagem de vídeo com um pedido urgente e incomum, especialmente financeiro, pare e verifique. Tente contatar a pessoa por outro meio de comunicação para confirmar a história.

- Use o Bom Senso: Se algo parece bom (ou ruim) demais para ser verdade, provavelmente é. Questione a fonte e procure por confirmação em veículos de imprensa confiáveis.

O Futuro da Autenticidade Digital

A luta contra os deepfakes é uma maratona, não uma corrida de 100 metros. A marca d’água generativa é um passo tecnológico fundamental, mas ela deve ser acompanhada por um esforço multifacetado que inclui regulamentação governamental, padronização internacional e, acima de tudo, educação pública. Promover a literacia digital e o pensamento crítico é essencial para construir uma sociedade resiliente à desinformação.

A era da inteligência artificial generativa nos trouxe ferramentas incríveis, mas também responsabilidades imensas. Proteger a verdade no mundo digital é um dever compartilhado entre empresas de tecnologia, governos e cada um de nós. A marca d’água generativa é a prova de que, para cada novo desafio tecnológico, a inovação humana pode e irá encontrar uma solução.

Referências

[1] World Economic Forum. (2025, 9 de outubro). Top 10 tecnologias emergentes de 2025. Brazil Economy. https://brazileconomy.com.br/2025/10/top-10-tecnologias-emergentes/

[2] Senado Notícias. (2025, 24 de outubro). IA e desinformação: por que as eleições de 2026 exigem atenção redobrada. Senado Federal. https://www12.senado.leg.br/noticias/materias/2025/10/24/ia-e-desinformacao-por-que-as-eleicoes-de-2026-exigem-atencao-redobrada-1

[3] NPR. (2025, 10 de outubro). How OpenAI’s Sora could change the internet with deepfakes. https://www.npr.org/2025/10/10/nx-s1-5567162/sora-ai-openai-deepfake

[4] International Telecommunication Union. (2025, 14 de outubro). Report on standards for AI watermarking and multimedia authenticity workshop. https://www.itu.int/hub/publication/t-ai4g-ai4good-2024-7/

Deixe um comentário